티스토리 뷰

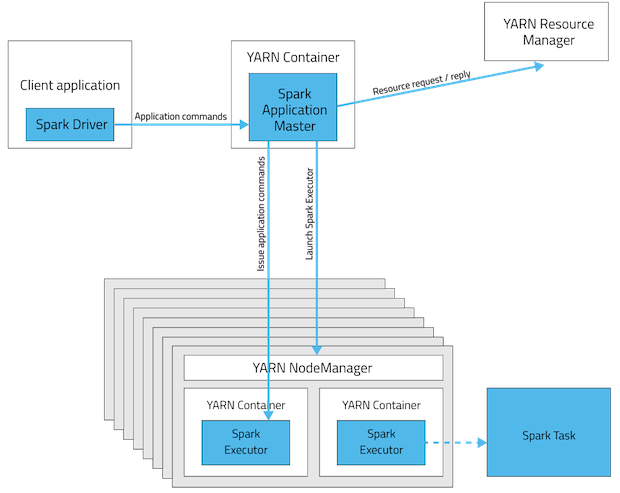

Spark Driver

- 하나의 노드에서 실행

- 스파크 전체의 main() 함수 실행

- SparkContext 객체 생성

- Application 내 정보의 유지, Executor의 실행 및 실행 분석 등의 역할 수행

- 사용자의 Job을 Task 단위로 변환

Cluster 모드

- Spakr Application 실행시 Application Master Process 생성 → Spark Driver를 실행하는 컨테이너

- Spark Driver와 Yarn Resource Manager가 협상을 통해 Application 실행을 위한 리소스 요구

- 할당 받은 Resource를 Yarn Node Manager에게 Spark Executor 실행을 위한 컨테이너 생성 지시

- spark context가 execurtor로 job(tasks)를 제출

- Yarn 클라이언트는 ApplicationMaster에서 상태만을 읽음

- 클라이언트는 애플리케이션 제출 후 종료 가능

- 주로 Spark Shell에서 사용

Client 모드

- Spark Driver가 Yarn Client에서 실행

- 따로 지정하지 않음 기본으로 선택되는 모드

- Spark Application을 실행했던 콘솔을 닫아 버리거나 기타 다른 방법으로 Client 프로세스 중지 → Spark Context도 함께 종료되면서 Spark JOB 중지

- Spark 드라이버가 Yarn 클라이언트에서 실행 → 따라서, Spark 드라이버를 Yarn 클러스터의 일부로 관리되지 않음

- 드라이버는 클라이언트의 일부 → Application이 완료될 때까지 종료될 수 없음

'BigData > Spark' 카테고리의 다른 글

| Spark 메모리 구조 (1) | 2024.02.11 |

|---|

공지사항

최근에 올라온 글

최근에 달린 댓글

- Total

- Today

- Yesterday

링크

TAG

- nifi

- java8

- 설정에러

- openjdk1.8

- bigdata #data_mesh

- hadoop

- Item Prototypes

- hdfs

- flink

- flow.xml.gz

- Bigdata

- Federation

- error

- OOM

- namenode

- Discovery Rule

- 빅데이터

- Dataflow

- Nifi Service

- 실시간처리

- nifi.flowcontroller.autoResumeState

- prometheus

- MAT

- Nifi Architecture

- exporter

- Apache Nifi

- Apache

- zabbix

- spark driver

- lld

| 일 | 월 | 화 | 수 | 목 | 금 | 토 |

|---|---|---|---|---|---|---|

| 1 | 2 | 3 | ||||

| 4 | 5 | 6 | 7 | 8 | 9 | 10 |

| 11 | 12 | 13 | 14 | 15 | 16 | 17 |

| 18 | 19 | 20 | 21 | 22 | 23 | 24 |

| 25 | 26 | 27 | 28 | 29 | 30 | 31 |

글 보관함